Wer sich mit der Virtualisierung und Digitalisierung der Arbeitswelten befasst, stolpert schnell über die Erkenntnis, dass es neben den handfesten Veränderungen für arbeitende Menschen auch um Drittmittelmärkte, um Strategien zur Erlangung von staatlichen Fördermitteln und um zeitweise substanzlose Marketingauftritte geht. Dieses Auseinanderklaffen von realen Notwendigkeiten und bloßen Akquise-Shows begegnet den kundigen Betrachtenden nun auch auf der Bühne des Wortes „Maschinenethik“.

Wer sich unkundig in die Sprachwelten der „Maschinenethik“ vorwagt, zuckt beeindruckt zurück. Da treten wissenschaftliche Teams auf, die sich mit vermeintlich spektakulären Erkenntnissen aufmachen, Fördermittel aus den staatlichen Händen auf europäischer, Bundes- oder Landes-Ebene zu ergattern. Da werden „Wirklichkeiten“ beschrieben, die keine sind, um Aufmerksamkeit zu erheischen. So schreibt ein akademischer Kopf, dass das zentrale Zukunftsthema der Digitalisierung und Virtualisierung die Herausforderung sei, dass Maschinen nun Ethik und Moral besitzen und ausführen könnten.

Die Maschine wird zum bewusstseinsfähigen Subjekt ernannt, das durch Datensammeln und Auswertungen Bewusstsein, Reflexionskompetenz, Ethik und Moral erlangen könnte. Die vermeintliche „Künstliche Intelligenz“ verfügt in solchen Beschreibungen alsbald über „Künstliche Ethik“ oder noch besser – wie ein nach Aufmerksamkeit strebender Ethiker schreibt – über „Künstliche Tugend“.

Klar, wenn man ein solches Szenario den zuständigen Vergabestellen der Ministerien einreden kann, hat man den sechs- bis siebenstelligen Betrag schon gewonnen. Wer wollte angesichts solcher Dämonen an der Wand der Zukunft nicht den Steuer-Geldbeutel für kulturelle Prävention öffnen.

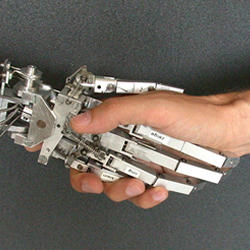

Bei allem Respekt vor Frauen und Männern aus Ingenieur- und Informationswissenschaften muss man laut „Halt“ rufen! Ein solches Verständnis und Szenario von „Maschinenethik“ ist schlicht inakzeptabel. Weder kann ein physischer Blechhaufen noch ein digitaler Software-Haufen im aufgeklärt sozialwissenschaftlichen, philosophischen und menschenrechtlichen Sinne Bewusstsein im Sinne des Humanum erreichen. Ein solches Gerede von „Maschinenethik“ will Aufmerksamkeit, will vorsätzlich verunsichern und den Golem herbeireden.

Betrachtet man die technologische Wirklichkeit des Status quo und die Arbeiten in Laboren, dann lässt sich zweifellos feststellen, dass hier Gigantisches geleistet wurde. Brillante Mathematik und hervorragende Informatik haben Software-Systeme (allen voran „Autonome Software-Systeme“) hervorgebracht, die in glänzender Weise zur Verfahrens- und Prozessteuerung geeignet sind. Diese Systeme spiegeln dem Menschen vor, dass die Software „denken“ könnte und der Mensch verhält sich entsprechend, um diese Projektion zu vervollkommnen.

Das Problem sitzt vor (!) dem Bildschirm. Der Mensch hält das Agieren der Software für Denken und orientiert sein eigenes Verhalten gemäß dieser Projektion. Nicht das nicht vorhandene Bewusstsein in (!) der Maschine ist zu hinterfragen, sondern das Naive im Bewusstsein des Menschen stellt die Herausforderung dar.

Gerade für einen konstruktiven und innovativen Umgang mit neuen digitalen Lösungen sollten wir uns nicht in die Sackgassen der Hollywood-Filme drängen lassen: Sogenannte „Künstliche Intelligenz“ mit Bewusstsein gibt es nicht. Auch nicht in naher Zukunft. Was es gibt, sind aufregend gute mathematische Anwendungen mit enormen Potenzialen. Diese gilt es, engagiert demokratisch und sozial zu gestalten. Lassen wir uns nicht von vermeintlichen „Maschinen-Ethikern“ davon abhalten.