Unter diesem Titel haben sich Aktive aus dem Forum Soziale Technikgestaltung und aus dem Kreis der Partner zusammengefunden, um im Angesicht der sogenannten „Künstlichen Intelligenz“ Beiträge aus der Perspektive der Gewerkschaften, der Sozialwissenschaften, der Philosophie, der Religionskritik und der Jurisprudenz über den Mensch zu verfassen. Nicht die Technikanalyse steht im Vordergrund sondern die Frage nach der Rolle des Menschen und dem Menschenbild. Die Beiträge wurden zusammengeführt und als 125seitiger Schwerpunkt in dem mehr als 260 Seiten umfassenden Journal „Latenz“ im Oktober 2019 (Latenz 04/2019) veröffentlicht.

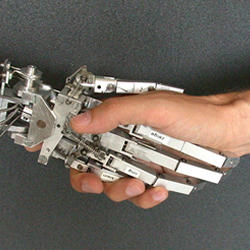

Ist die Frage nach einem ethischen Menschenbild ein überholter Romantizismus oder eine soziale Notwendigkeit der Aufklärung für den Zusammenhalt von Gesellschaften? Was sind die zukunftsweisenden Erbschaften einer Jahrhunderte übergreifenden Diskussion um das Bild des Menschen? Worauf basiert ein solidarisches Menschenbild? Welches Menschenbild transportieren die Bürger- und Menschenrechte? Wie lässt sich vermeiden, dass einseitig gesetzte und in Technik implementierte Profile von digitalen Figuren den demokratischen Regeln und Rechten der Vielfalt, der Integration und Inklusion zuwiderlaufen? Welche Konsequenzen haben die aktuellen technischen wie gesellschaftlichen Transformationsprozesse für eine philosophische Anthropologie?

Mit seinem Beitrag „Menschenbilder, Visionen, Normen: Orientierungen für ‚Gute Arbeit mit KI‘“ greift der Ver.di-Gewerkschafter Lothar Schröder in die Kontroverse um die „Künstliche Intelligenz“ ein. Aus arbeitsweltlicher Perspektive ermutigt er zur Weiterentwicklung der Humanisierung der Arbeit durch die Selbstbestimmung des Menschen: „Den Menschen als digitale Maschine zu deuten und ihn entsprechend programmierten, ‚lernenden‘ Systemen auszusetzen oder gar unterzuordnen, muss zwangsläufig zu inhumanen und inakzeptablen Resultaten führen.“

Für das „Recht auf Irrationalität“ angesichts der „zunehmenden Unbewohnbarkeit von Fiktionen“ spricht sich der Soziologe Stefan Selke aus. In Hinblick auf Big Data und die Verschiebung des Humanum durch erweiterte Digitalisierungen plädiert der Autor für die „selbstbestimmte Erzählbarkeit.“ Der Tübinger Philosoph Helmut Fahrenbach geht der anthropologischen Frage im Denken von Ernst Bloch nach. Unter dem Titel „Das Leben künstlich oder menschlich machen?“ übt Annette Schlemm philosophische Kritik an den Denkgebäuden des Transhumanismus. Sie verteidigt die zivilgesellschaftliche Vielfalt gegen technikgläubigen Reduktionismus. In brillanter Schärfe zeigt uns der Jurist Ingo Müller die Relevanz der Grundrechte auf und, „dass im Zentrum unserer Werteordnung die Grundrechte stehen, nicht Staat oder Kirche, sondern der Mensch“.

In einem Interview von Johanna Di Blasi kommt der Filmemacher Alexander Kluge zu Wort. Mit seiner Formel von der „Achtung vor Robotern“ setzt er sich mit der „sozialen Intelligenz der Maschinen und Goethes Homunculus, der klüger ist als der Mensch“ auseinander. Aus der Schweiz meldet sich Kurt Seifert mit einem philosophisch-politischen Text zu Wort: „Was fehlt? Transhumanismus als Anti-Utopie“. Mit der Widersprüchlichkeit und der historischen Belastetheit des Terminus „Der neue Mensch“ verknüpft der Autor frühe Diskussionen im Russland der zwanziger Jahre mit späteren autoritären Terrorformen Stalins und Mao Tse Tungs. Gegen eine einseitige Aufhübschung der Debatte um die sogenannten „Künstliche Intelligenz“ nimmt Welf Schröter in seiner pointierten nachdenklichen Polemik „Warum der Begriff ‚KI‘ nicht als ‚künstliche‘ sondern nur als ‚kleine‘ oder ‚keine Intelligenz‘ ausgeschrieben werden sollte“ aus gestaltungsspezifischer Sicht Stellung. Anknüpfend hat sich der Sozialwissenschaftler György Széll auf den Weg gemacht, eine umfangreiche, wertende Sammelrezension zu „KI“-Publikationen zu erstellen. Unter dem Titel „Homo sapiens demens“ bewegt er sich durch die Literatur.

Buchangaben: Latenz – Journal für Philosophie und Gesellschaft, Arbeit und Technik, Kunst und Kultur. Ausgabe 04|2019. Der Künstliche Mensch? Menschenbilder im 21. Jahrhundert. Hrsg. von Irene Scherer und Welf Schröter. Redaktion: Matthias Mayer, Mathias Richter, Inka Thunecke, Irene Scherer und Welf Schröter. 2019, 264 Seiten, 34,00 Euro, ISBN 978-3-89376-185-2.